GloVe简介

GloVe的全称叫 Global Vectors for Word Representation,它是一个基于全局词频统计(count-based & overall statistics)的词表征(word representation)工具。

Glove与LSA的区别

LSA(Latent Semantic Analysis)是一种比较早的 count-based 的词向量表征工具,它也是基于 co-occurance matrix 的,只不过采用了基于奇异值分解(SVD)的矩阵分解技术对大矩阵进行降维,而我们知道 SVD 的复杂度是很高的,所以它的计算代价比较大。还有一点是它对所有单词的统计权重都是一致的。而这些缺点在 GloVe 中被一一克服了。

GloVe与word2vec的区别

GloVe 与 word2vec,两个模型都可以根据词汇的“共现 co-occurrence”信息,将词汇编码成一个向量(所谓共现,即语料中词汇一块出现的频率)。两者最直观的区别在于,word2vec 是“predictive”的模型,而 GloVe 是“count-based”的模型。

- Predictive 的模型,如 Word2vec,根据 context 预测中间的词汇,要么根据中间的词汇预测 context,分别对应了 word2vec 的两种训练方式 cbow 和 skip-gram。对于 word2vec,采用三层神经网络就能训练,最后一层的输出要用一个 Huffuman 树进行词的预测。

- Count-based 模型,如 GloVe,本质上是对共现矩阵进行降维。首先,构建一个词汇的共现矩阵,每一行是一个 word,每一列是 context。共现矩阵就是计算每个 word 在每个 context 出现的频率。由于 context 是多种词汇的组合,其维度非常大,我们希望像 network embedding 一样,在 context 的维度上降维,学习 word 的低维表示。这一过程可以视为共现矩阵的重构问题,即 reconstruction loss。

相比 Word2Vec,GloVe 更容易并行化,所以对于较大的训练数据,GloVe 更快。

Glove实现原理

GloVe 的实现分为以下几步:

1.构建共现矩阵

共现矩阵顾名思义就是共同出现的意思。局域窗中的 word-word 共现矩阵可以挖掘语法和语义信息,例如:

I like deep learning. I like NLP. I enjoy flying

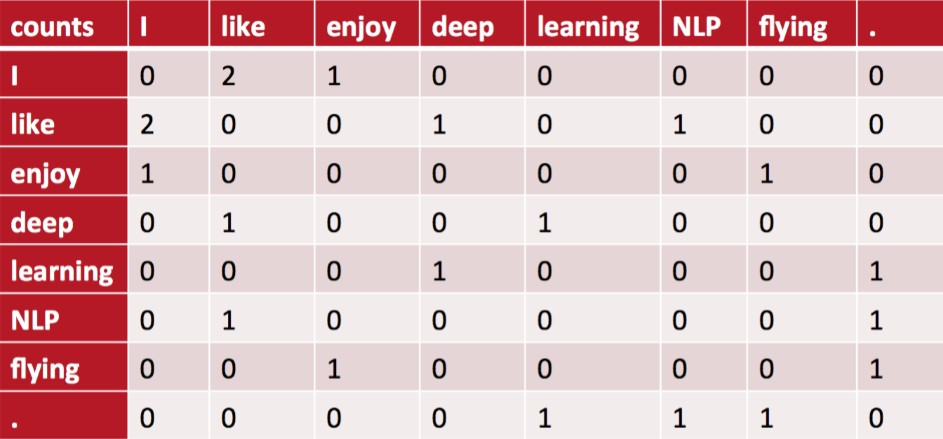

以上三句话设置滑窗为 2,可以得到一个词典:{“I like”, “like deep”, “deep learning”, “like NLP”, “I enjoy”, “enjoy flying”, “I like”}。我们可以得到一个共现矩阵(对称矩阵):

中间的每个格子表示的是行和列组成的词组在词典中共同出现的次数,也就体现了共现的特性。

GloVe的共现矩阵

根据语料库(corpus)构建一个共现矩阵(Co-ocurrence Matrix)$X$,矩阵中的每一个元素 $X_{ij}$ 代表单词 $i$ 和上下文单词 $j$ 在特定大小的上下文窗口(context window)内共同出现的次数。一般而言,这个次数的最小单位是 1,但是 GloVe 不这么认为:它根据两个单词在上下文窗口的距离 $d$,提出了一个衰减函数(decreasing weighting):$decay=1/d$ 用于计算权重,也就是说距离越远的两个单词所占总计数(total count)的权重越小。

2.词向量和共现矩阵的近似关系

构建词向量(Word Vector)和共现矩阵(Co-ocurrence Matrix)之间的近似关系,论文的作者提出以下的公式可以近似地表达两者之间的关系:

$$w_{i}^{T}\tilde{w_{j}}+b_i+\tilde{b_j}=\log(X_{ij})$$

其中 $w_{i}^{T}$ 和 $\tilde{w_{j}}$ 是我们最终要求解的词向量,$b_i$ 和 $\tilde{b_j}$ 分别是两个词向量的 bias term。问题来了,这个公式是如何来的?为了把这个问题说清楚,我们先定义一些变量:

- $X_{ij}$ 表示单词 $j$ 出现在单词 $i$ 的上下文中的次数

- $X_{i}$ 表示单词 $i$ 的上下文中所有单词出现的总次数,即 $X_{i}=\sum^{k}X_{ik}$

- $P_{ij}=P(j|i)=X_{ij}/X_{i}$,即表示单词 $j$ 出现在单词 $i$ 的上下文中的概率

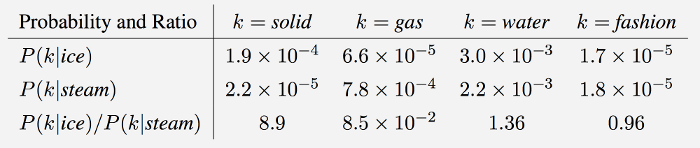

有了这些定义之后,我们来看一个表格:

理解这个表格的重点在最后一行,它表示的是两个概率的比值(ratio),我们可以使用它观察出两个单词 $i$ 和 $j$ 相对于单词 $k$ 哪个更相关(relevant)。比如,ice 和 solid 更相关,而 stream 和 solid 明显不相关,于是我们会发现 $P(solid|ice)/P(solid|steam)$ 比 1 大更多。同样的 gas 和 steam 更相关,而和 ice 不相关,那么 $P(gas|ice)/P(gas|steam)$ 就远小于 1;当都有关(比如 water)或者都没有关(fashion)的时候,两者的比例接近于 1;这个是很直观的。因此,以上推断可以说明通过概率的比例而不是概率本身去学习词向量可能是一个更恰当的方法,因此下文所有内容都围绕这一点展开。于是为了捕捉上面提到的概率比例,我们可以构造如下函数:

$$F(w_i,w_j,\tilde{w_k})=\frac{P_{ik}}{P_{jk}}$$

其中,函数 $F$ 的参数和具体形式未定,它有三个参数 $w_i$、$w_j$ 和 $\tilde{w_k}$,$w$ 和 $\tilde{w}$ 是不同的向量;

因为向量空间是线性结构的,所以要表达出两个概率的比例差,最简单的办法是作差,于是我们得到:

$$F(w_i-w_j,\tilde{w_k})=\frac{P_{ik}}{P_{jk}}$$

这时我们发现公式 5 的右侧是一个数量,而左侧则是一个向量,于是我们把左侧转换成两个向量的内积形式:

$$F((w_i-w_j)^T\tilde{w_k})=\frac{P_{ik}}{P_{jk}}$$

我们知道 $X$ 是个对称矩阵,单词和上下文单词其实是相对的,也就是如果我们做如下交换:$w\leftrightarrow\tilde{w_k}$,$X\leftrightarrow X^T$ 公式 6 应该保持不变,那么很显然,现在的公式是不满足的。为了满足这个条件,首先,我们要求函数 $F$ 要满足同态特性(homomorphism):

$$F((w_i-w_j)^T\tilde{w_k})=\frac{F(w_i^T\tilde{w_k})}{F(w_j^T\tilde{w_k})}$$

结合公式,我们可以得到:

$$F(w_i^T\tilde{w_k})=P_{ik}=\frac{X_{ik}}{X_i}$$

然后,我们令 $F=\exp$,于是我们有:

$$w_i^T\tilde{w_k}=\log(P_{ik})=\log(X_{ik})–\log({X_i})$$

此时,我们发现因为等号右侧的 $\log(X_i)$ 的存在,上式是不满足对称性(symmetry)的,而且这个 $\log(X_i)$ 其实是跟 $k$ 独立的,它只跟 $i$ 有关,于是我们可以针对 $w_i$ 增加一个 bias term $b_i$ 把它替换掉,于是我们有:

$$w_i^T\tilde{w_k}+b_i=\log(X_{ik})$$

但是以上公式还是不满足对称性,于是我们针对 $w_k$ 增加一个 bias term $b_k$,从而得到:

$$w_i^T\tilde{w_k}+b_i+b_k=\log(X_{ik})$$

3.构造损失函数

有了公式之后我们就可以构造它的损失函数:

$$J=\sum_{i,j=1}^{V}f(X_{ij})(w_{i}^{T}\tilde{w_{j}}+b_i+\tilde{b_j}–\log(X_{ij}))^2$$

这个损失函数的基本形式就是最简单的 mean square loss,只不过在此基础上加了一个权重函数 $f(X_{ij})$,那么这个函数起了什么作用,为什么要添加这个函数呢?我们知道在一个语料库中,肯定存在很多单词他们在一起出现的次数是很多的(frequent co-occurrences),那么我们希望:

- 这些单词的权重要大于那些很少在一起出现的单词(rare co-occurrences),所以这个函数要是非递减函数(non-decreasing);

- 我们也不希望这个权重过大(overweighted),当到达一定程度之后应该不再增加;

- 如果两个单词没有在一起出现,也就是 $X_{ij}=0$,那么他们应该不参与到损失函数的计算当中去,也就是 $f(x)$ 要满足 $(0)=0$

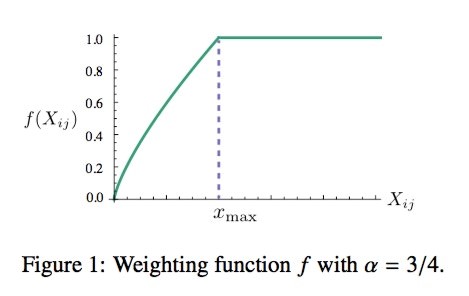

满足以上两个条件的函数有很多,作者采用了如下形式的分段函数:

$$f(x)=\{\begin{array}{ll}(x/x_{\max})^{\alpha}&\text{if}x<x_{\max}\\1&\text{otherwise}\end{array}$$

这个函数图像如下所示:

4. 训练 GloVe 模型

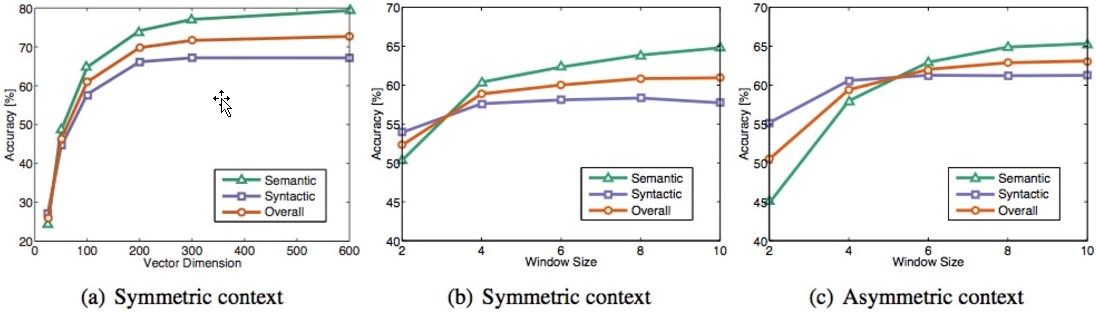

虽然很多人声称 GloVe 是一种无监督(unsupervised learing)的学习方式(因为它确实不需要人工标注 label),但其实它还是有 label 的,这个 label 就是公式中的 $\log(X_{ij})$,而公式中的向量 $w$ 和 $\tilde{w}$ 就是要不断更新学习的参数,所以本质上它的训练方式跟监督学习的训练方法没什么不一样,都是基于梯度下降的。具体地,论文里的实验采用了 AdaGrad 的梯度下降算法,对矩阵 $X$ 中的所有非零元素进行随机采样,学习曲率(learning rate)设为 0.05,在 vector size 小于 300 的情况下迭代了 50 次,其他大小的 vectors 上迭代了 100 次,直至收敛。最终学习得到的是两个 vector 是 $w$ 和 $\tilde{w}$,因为 $X$ 是对称的(symmetric),所以从原理上讲 $w$ 和 $\tilde{w}$ 是也是对称的,他们唯一的区别是初始化的值不一样,而导致最终的值不一样。所以这两者其实是等价的,都可以当成最终的结果来使用。但是为了提高鲁棒性,我们最终会选择两者之和 $w+\tilde{w}$ 作为最终的 vector(两者的初始化不同相当于加了不同的随机噪声,所以能提高鲁棒性)。在训练了 400 亿个 token 组成的语料后,得到的实验结果如下图所示:

这个图一共采用了三个指标:语义准确度,语法准确度以及总体准确度。那么我们不难发现 Vector Dimension 在 300 时能达到最佳,而 context Windows size 大致在 6 到 10 之间。

Glove 实战:文本分类

对于文本分类最简单最常用的比如通过朴素贝叶斯,N-Grams 这些方法来做分类识别。

TF-IDF+N-Grams

1、首先对语料库进行切词,维护自己的词典,做高频词的人工复审,将无意词进行 stop_words 归总

2、进行 tf-idf,将词进行重赋权,有效的将向量化中的 one hot encoding 结果进行了修正。但是依然存在问题:在 TFIDF 算法中并没有体现出单词的位置信息。

# sublinear_tf:replace tf with 1+log(tf) # max_df:用来剔出高于词频 0.5 的词 # token_pattern:(?u)\b\w+\b 是为了匹配出长度为 1 及以上的词,默认的至少需要词长度为 2 # ngram_range:这边我做了 3-grams 处理,如果只想朴素计算的话 (1,1) 即可 # max_features:随着我做了各种宽松的条件,最后生成的词维度会异常大,这边限制了前 3 万 vectorizer = TfidfVectorizer(stop_words=stpwrdlst, sublinear_tf=True, max_df=0.5, token_pattern=r"(?u)\b\w+\b", ngram_range=(1,3), max_features=30000)

3、在经过 TfidfVectorizer 处理之后的结果是以稀疏矩阵的形式来存的,如果想看内容的话,可以用 todense() 转化为 matrix 来看。接下来,用贝叶斯来训练刚才得到的矩阵结果就可以了。

mnb_tri = MultinomialNB(alpha=0.001) mnb_tri.fit(tri_train_set.tdm, tri_train_set.label)

tf-idf+n-grams+naive-bayes+lr

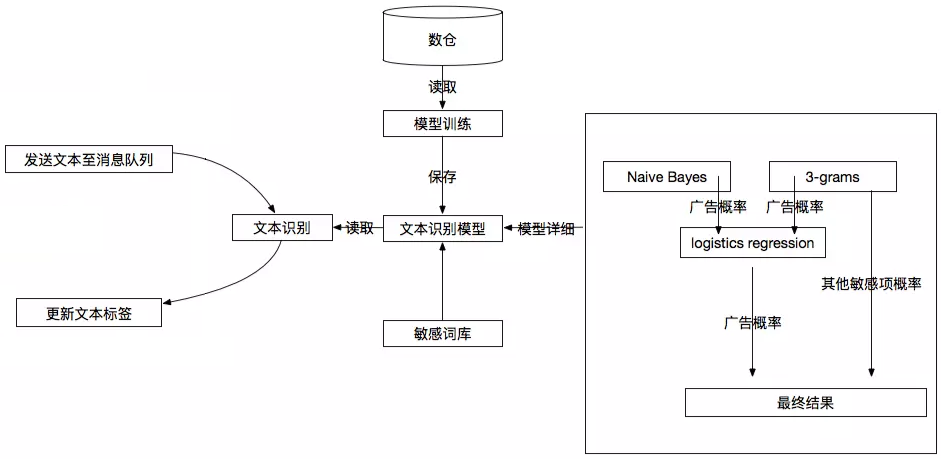

这种方法是上面方法的升级版本,我们先看下架构:

其实主要差异在于右侧的算法模型详细部分,我们做了一个由 3-grams 到 3-grams+naive-bayes+lr 的扩充,提升精度。在模型的过程中,上面的第一步,都是一样的,在第二、三步有所差异:

2、在第二步中,我们除了要构造出一个 3-grams 的 sparse matrix 也需要构造出一个朴素的 sparse matrix

# 朴素结果 vectorizerby = TfidfVectorizer(stop_words=stpwrdlst, token_pattern=r"(?u)\b\w+\b", max_df=0.5, sublinear_tf=True, ngram_range=(1,1), max_features=100000)

3、不仅仅用 bayes 进行一次分类,而是根据 3-grams 和朴素情况下的 sparse matrix 进行预测,再用 logistics regression 来合并两个的结果做个 stack 进行 0-1 压缩。

# 构造出一个 3-grams 的 sparse matrix 也需要构造出一个朴素的 sparse matrix mnb_tri = MultinomialNB(alpha=0.001) mnb_tri.fit(tri_train_set.tdm, tri_train_set.label) mnb_by = MultinomialNB(alpha=0.001) mnb_by.fit(by_train_set.tdm, by_train_set.label) # 加 bias,cv 选择最优正则结果,lbfgs 配合 l2 正则 lr = LogisticRegressionCV(multi_class="ovr", fit_intercept=True, Cs=np.logspace(-2,2,20), cv=2, penalty="l2", solver="lbfgs", tol=0.01) re = lr.fit(adv_data[['f1','f2']], adv_data['rep_label'])

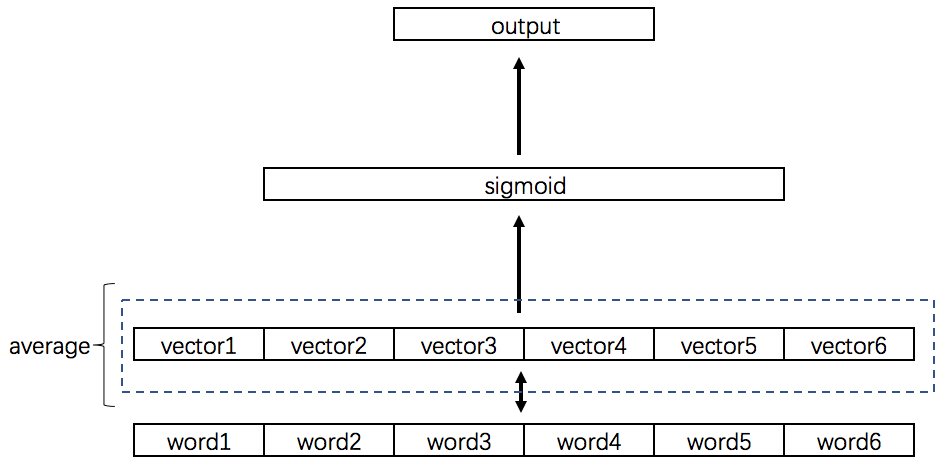

GloVe+lr

- 通过语料计算每个词的词向量

- 有了每个词的向量,然后取句子的向量平均:

举个例子:存在一句话“我爱中国”,“我”的向量是[0.3, 0.2, 0.3],“爱”的向量是[0.1, 0.2, 0.3],“中国”的向量是[0.6, 0.6, 0.4],那么average后就是[0.33, 0.33, 0.33],然后这就类似一个特征为三的input。这种方法的好处就是快捷,预处理的工作代价要小,随着数据量的增多,模型的效果要更加的好。

参考链接: