模型概述

RALM(Retrieval-Augmented Look-alike Model)是由腾讯公司于2019年提出并成功应用于微信“看一看”推荐场景的创新模型。该模型的核心目标在于解决传统推荐系统中普遍存在的长尾内容分发难题,即大量缺乏丰富历史交互数据的新内容或小众内容难以被精准推荐给潜在兴趣用户的问题。

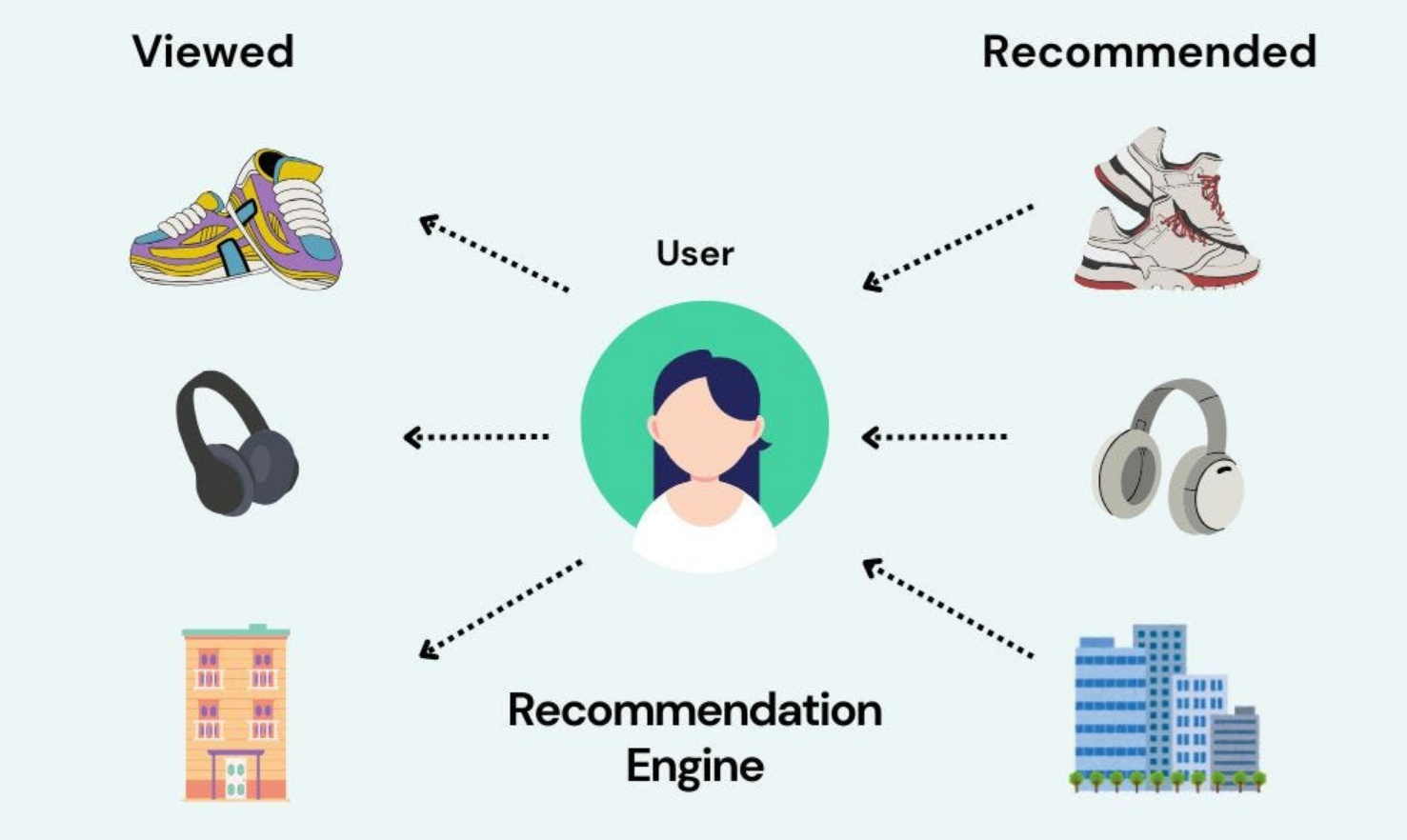

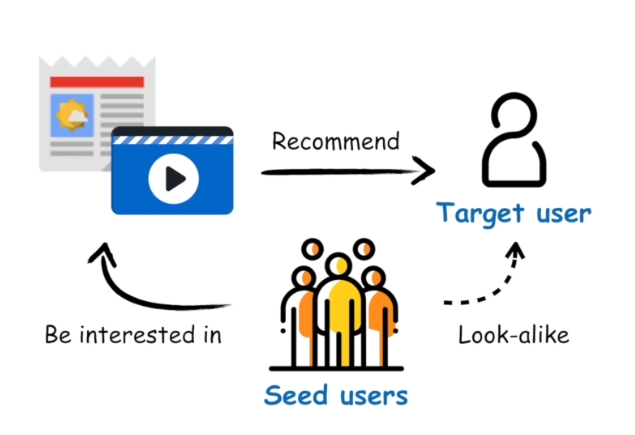

RALM摒弃了传统上主要依赖物品(Item)自身静态特征进行匹配的思路,转而采用一种动态、个性化的物品表征方法:通过物品的种子用户群来表征物品本身。只要一个内容项能积累少量初始互动用户(种子用户),RALM就能通过计算目标用户与种子用户群的相似度,将该内容扩散给更广泛的潜在兴趣人群,从而有效激活长尾内容生态。

核心模块与设计思想

RALM模型由三个核心模块构成,其设计紧密围绕“用户-用户”匹配这一核心思路展开。

| 模块名称 | 核心功能 | 关键技术 / 设计思想 | 要解决的关键问题 |

| 用户表征学习 | 将用户多维、异构的行为数据(如点击、停留、分享等)聚合、压缩为一个综合、精准的低维向量(Embedding)。 | 基于改进的YouTube DNN模型,并引入注意力融合层。 | 避免模型被少数强特征域(如热门标签)主导,确保用户多样化、差异化的兴趣都能在最终向量中得到均衡、合理的表达。 |

| Look-alike学习 | 计算目标用户与待推荐内容项的种子用户群体之间的相似度。这是RALM模型的核心匹配环节。 | 采用双塔结构:一塔编码目标用户,另一塔编码种子用户群体。结合全局注意力(捕捉种子人群的整体共性)与局部注意力(捕捉与目标用户最相关的个性化兴趣)。 | 将传统的“用户-物品”匹配问题,巧妙地转化为“用户-用户群”匹配问题。同时,兼顾种子人群的集体偏好和与目标用户相关的个性化兴趣点。 |

| 系统架构设计 | 支撑模型在工业级生产环境中实现高并发、低延迟的实时推理与服务。 | 三层流水线架构: 1. 离线训练:定期更新用户和种子人群的Embedding。 2. 在线异步处理:实时处理用户新行为,微调用户向量。 3. 线上服务:高效完成向量检索与相似度计算。 | 在追求极致推荐效果的同时,必须平衡高并发、低延迟的线上服务要求,确保系统稳定可用。 |

创新价值与业务成效

RALM模型的根本性创新在于其推荐范式的转变。它不再孤立地看待物品,而是将物品置于其受众网络中,通过“物以类聚,人以群分”的思想进行动态表征。这种方法对历史行为稀疏的长尾内容极具价值,因为它降低了对内容自身特征完备性的依赖,转而利用“只要有用户喜欢,就能找到相似用户”的社会化扩散逻辑。

在微信“看一看”的线上A/B测试中,RALM模型取得了显著的业务效果:

- 效果提升:在显著扩大内容曝光量的基础上,整体点击率(CTR)仍提升了约09%。

- 生态改善:推荐内容的种类丰富性和标签多样性大幅提升,打破了信息茧房。

- 核心价值:实验证明,RALM能够在不牺牲主流内容点击率的前提下,有效促进长尾、小众内容的精准分发,从而缓解了推荐系统“强者恒强”的马太效应,促进了内容生态的健康与多元化。

核心代码实现与技术细节

RALM模型的工业级部署依赖于一个清晰、高效且可维护的代码架构。其实现主要包括以下几个核心模块:用户表征学习、Look-alike双塔匹配以及高性能在线服务。

用户表征学习模块实现

用户表征学习的核心是将用户多维行为数据(如点击序列、停留时长、分享记录)编码为一个统一的低维向量。实践中常采用改进的深度神经网络(DNN),并引入注意力机制以平衡不同行为域的重要性。

关键技术点:

- 特征融合与注意力:避免模型被少数强势特征(如热门标签)主导。通过注意力层动态计算不同特征域的权重,确保多样化的用户兴趣得到均衡表达。

- 高效训练:使用负采样技术应对大规模用户-物品交互数据,并通过离线异步任务定期更新用户Embedding,以捕捉兴趣的动态变化。

Look-alike双塔结构实现

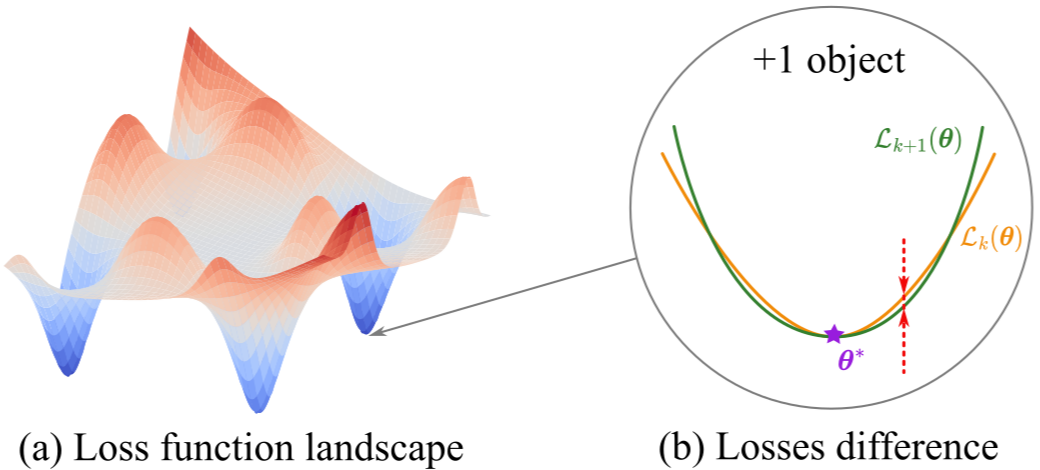

这是RALM模型的核心匹配环节,其目标是比较目标用户向量与种子用户群向量的相似度。标准的双塔结构将目标用户和种子用户群分别输入两个独立的神经网络(塔),并计算其输出向量的相似度(如点积或余弦相似度)。

代码框架示例(基于PyTorch风格描述):

import torch

import torch.nn as nn

import torch.nn.functional as F

class LookAlikeTwinTower(nn.Module):

"""

RALM模型中的双塔结构,用于计算目标用户与种子用户群的相似度。

"""

def __init__(self, user_embed_dim=128, hidden_dim=256):

super().__init__()

# 目标用户塔

self.target_user_tower = nn.Sequential(

nn.Linear(user_embed_dim, hidden_dim),

nn.BatchNorm1d(hidden_dim),

nn.ReLU(),

nn.Dropout(0.3),

nn.Linear(hidden_dim, hidden_dim // 2),

nn.ReLU(),

nn.Linear(hidden_dim // 2, 64) # 最终输出向量维度

)

# 种子用户群塔(输入为种子用户向量的聚合,如平均池化后的结果)

self.seed_group_tower = nn.Sequential(

nn.Linear(user_embed_dim, hidden_dim),

nn.BatchNorm1d(hidden_dim),

nn.ReLU(),

nn.Dropout(0.3),

nn.Linear(hidden_dim, hidden_dim // 2),

nn.ReLU(),

nn.Linear(hidden_dim // 2, 64)

)

def forward(self, target_user_embed, seed_group_embed_aggregated):

"""

前向传播,计算相似度得分。

target_user_embed: 目标用户的表征向量 [batch_size, user_embed_dim]

seed_group_embed_aggregated: 种子用户群聚合后的表征向量 [batch_size, user_embed_dim]

"""

target_vec = self.target_user_tower(target_user_embed)

seed_vec = self.seed_group_tower(seed_group_embed_aggregated)

# 使用余弦相似度或点积作为匹配分数

similarity_score = F.cosine_similarity(target_vec, seed_vec, dim=1)

return similarity_score

注意力机制集成:在种子用户群塔中,可集成全局注意力(捕捉群体共性)与局部注意力(捕捉与目标用户最相关的个体兴趣),以提升匹配的精准度。

工程部署与服务化示例

工业级系统要求高并发、低延迟。RALM模型常部署为三层流水线架构,并通过微服务(如FastAPI)对外提供API服务。

服务核心流程:

- 在线异步处理:实时消费用户行为日志流(如Kafka),调用轻量级模型微调用户Embedding。

- 向量检索与计算:服务接收到推荐请求后,从向量数据库中检索出候选内容及其对应的种子用户群Embedding。

- 实时相似度计算:调用部署好的双塔模型,计算目标用户与各候选种子群的相似度得分。

- 排序与返回:依据得分对候选内容进行排序,返回Top-K结果。

部署要点:

- 模型缓存与版本管理:使用缓存(如DiskCache)避免每次请求重复加载模型,并通过版本清单管理多模型版本,支持热更新与回滚。

- 高性能向量检索:集成近似最近邻搜索库(如FAISS)以应对海量向量间的快速相似度检索。

- 服务监控与降级:实现完善的日志、指标监控(如QPS、延迟、错误率),并设计降级策略,当核心模型服务异常时能切回基础规则推荐。

总结

RALM模型是推荐系统领域一个重要的工程实践与思路创新。它通过引入“基于种子用户的Look-alike扩散”机制,为长尾推荐这一经典难题提供了一个高效、实用的解决方案。其成功应用表明,在推荐系统中,利用用户社会关系或兴趣相似性进行群体扩展,是挖掘潜在兴趣、激活冷门内容的一条有效路径,对构建更公平、更丰富的数字内容生态具有重要借鉴意义。

参考链接: